Page 116 - Rassegna 2025-3

P. 116

SCIENTIAE

2. I modelli linguistici allargati, cosa sono e perché

Sono trascorsi più di sessant’anni dal lavoro pioneristico di Rosemblatt

6

(1960) ma sembra che solo negli ultimi trenta l’applicazione di questi sistemi intel-

ligenti ha palesato un salto qualitativo (Helman, 1991): negli anni ottanta l’intro-

duzione dell’algoritmo error backpropagation (Rumelhart, Mc Clelland, 1986) ha

suscitato un’ondata di entusiasmo, favorendo un f orilegio di dati sperimentali

destinati, però, solo a pochi e con scarsa partecipazione di altre discipline.

Negli ultimi anni, le reti neuronali profonde (Deep Neural Network) hanno

apportato notevoli variazioni ai modelli preesistenti, favorendo, in tal guisa, la par-

tecipazione di discipline come la psicologia il cui contributo è quello di emulare il

comportamento umano, contestualizzato non solo in una cornice culturale di rife-

rimento, ma di studiare il comportamento umano in dif erenti contesti.

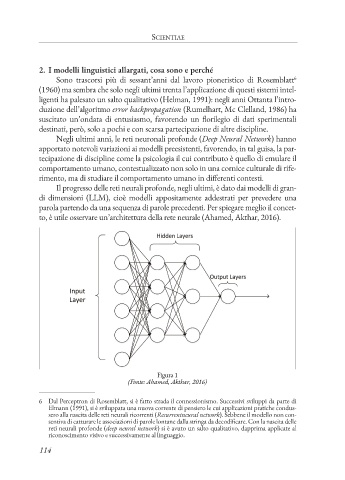

Il progresso delle reti neurali profonde, negli ultimi, è dato dai modelli di gran-

di dimensioni (LLM), cioè modelli appositamente addestrati per prevedere una

parola partendo da una sequenza di parole precedenti. Per spiegare meglio il concet-

to, è utile osservare un’architettura della rete neurale (Ahamed, Akthar, 2016).

Figura 1

(fonte: Ahamed, Akthar, 2016)

6 Dal Perceptron di Rosemblatt, si è fatto strada il connessionismo. Successivi sviluppi da parte di

Elmann (1991), si è sviluppata una nuova corrente di pensiero le cui applicazioni pratiche condus-

sero alla nascita delle reti neurali ricorrenti (recurrentneural network). Sebbene il modello non con-

sentiva di catturare le associazioni di parole lontane dalla stringa da decodif care. Con la nascita delle

reti neurali profonde (deep neural network) si è avuto un salto qualitativo, dapprima applicate al

riconoscimento visivo e successivamente al linguaggio.

114